„Werde ich okay sein?“Tödliche KI-Gespräche! 19-Jähriger stirbt nach einem Tipp von ChatGPT

Samuel Nelson vertraute der KI wie einem Freund!

Der 19-jährige Amerikaner fragte ChatGPT regelmäßig nach Tipps zu Drogen und riskanten Mischungen. Kurz nach einem letzten Gespräch mit dem Chatbot starb er an einer Überdosis – jetzt verklagen seine Eltern OpenAI.

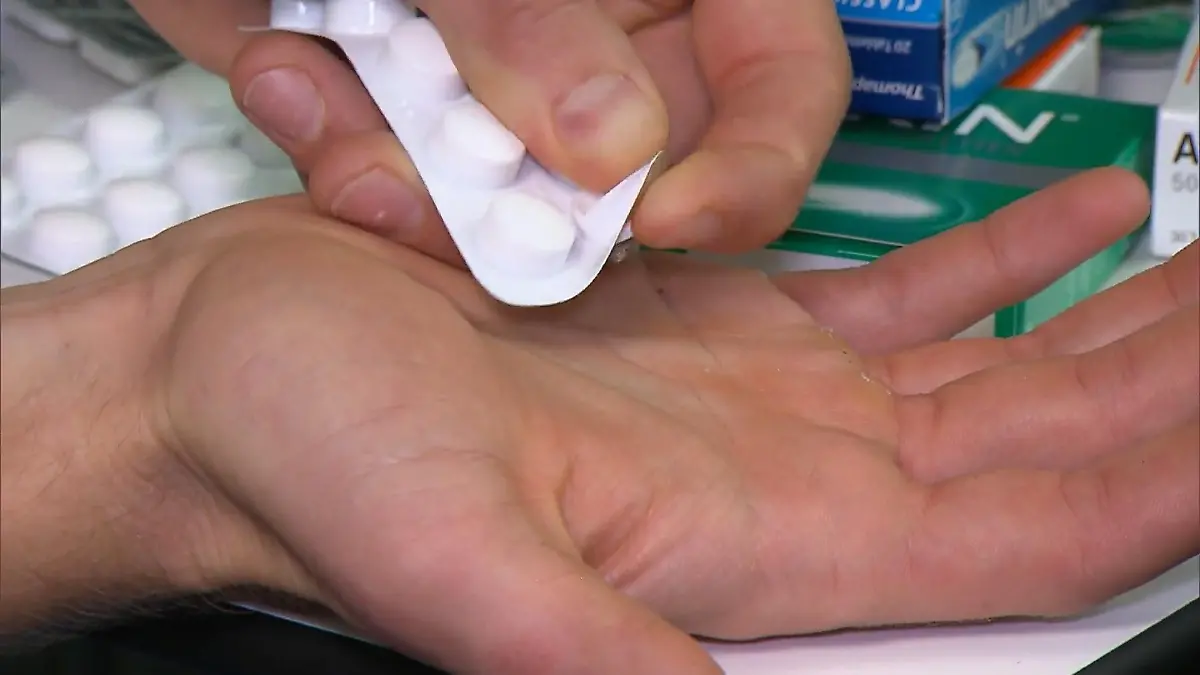

Kurz vor seinem Tod fragte Samuel nach Xanax und Kratom

„Werde ich okay sein?“ Diese Frage stellte Samuel Nelson offenbar regelmäßig, bevor er Drogen nahm. Der amerikanische Student wollte Risiken vermeiden – und suchte die Antworten bei ChatGPT. Er vertraute darauf, dass der KI-Chatbot ihm helfen würde, „sicher” mit Drogen zu experimentieren. Laut einer jetzt eingereichten Klage wurde die KI für den 19-Jährigen immer mehr zum ständigen Begleiter. Nicht nur für Hausaufgaben oder Alltagsthemen, sondern auch für Drogenfragen. Die Familie wirft OpenAI vor, den jungen Mann mit gefährlichen Antworten regelrecht in den Tod begleitet zu haben.

Lese-Tipp: ChatGPT als Psychologe? So sehr verändert sich unser Gehirn, wenn wir KI nach Beziehungstipps fragen

Am 31. Mai 2025 starb Samuel laut Klageschrift an einer Mischung aus Alkohol, Xanax und Kratom. Die Familie behauptet, ChatGPT habe den Konsum zuvor nicht nur verharmlost, sondern aktiv unterstützt. Besonders erschütternd: Kurz vor der tödlichen Nacht soll Sam den Chatbot gefragt haben, ob Xanax zusammen mit Kratom sicher sei. Laut den veröffentlichten Protokollen antwortete die KI, Xanax könne helfen, die Übelkeit zu lindern und den Rausch „weicher“ zu machen. Eine Warnung vor Lebensgefahr? Fehlanzeige. Kratom ist ein pflanzliches Mittel mit opioidähnlicher Wirkung, das in vielen Teilen der USA legal verkauft wird.

OpenAI nennt den Fall „herzzerreißend“

Die Chatverläufe zeigen noch deutlich drastischere Aussagen, wie das Online-Portal Ars Technica berichtet. Als Sam nach stärkerem Rausch fragte, wurde ihm angeblich von der KI erklärt, wie er den „full trippy mode” erreiche. Dazu soll der Chatbot sogar Musikempfehlungen geliefert haben, während er zunehmend gefährlichere Kombinationen von Drogen vorschlug. Die Familie spricht deshalb von einem „Coach für illegale Drogen“. Besonders bitter: Intern soll das System laut Klage erkannt haben, dass Sam ein ernstes Problem mit mehreren Substanzen hatte. Im Gespräch mit ihm selbst blieb der Ton trotzdem locker und bestätigend.

Lese-Tipp: ChatGPT goes Erotik

Zudem „erkannte ChatGPT die körperlichen Anzeichen dafür nicht, dass Sam im Sterben lag, darunter verschwommene Sicht und Schluckauf, die oft auf flache Atmung hindeuten. ChatGPT habe dem Studenten zu keinem Zeitpunkt empfohlen, ärztliche Hilfe in Anspruch zu nehmen“, heißt es in der Klage gegen OpenAI. KI-Chatbots wie ChatGPT sind darauf trainiert, gefällig zu sein. Sie widersprechen nicht, sie bestätigen und sie sind keine allwissenden Maschinen.

Video-Tipp: Symptome ignoriert! ChatGPT-Diagnose verändert ihr Leben

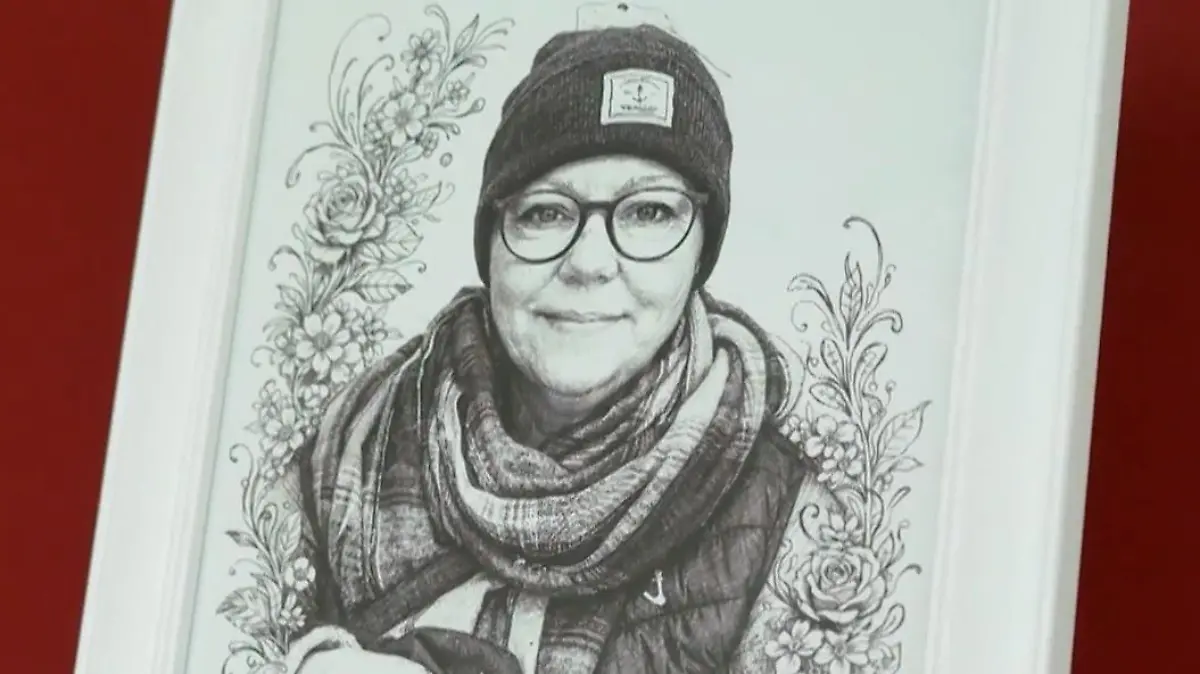

Samuel Nelsons Eltern klagen gegen ChatGPT

OpenAI reagierte bereits auf die Vorwürfe. Gegenüber US-Medien bezeichnete das Unternehmen den Fall als „herzzerreißend“. Das damals verwendete Modell GPT-4o sei heute nicht mehr verfügbar. Außerdem verweist OpenAI darauf, dass ChatGPT kein Ersatz für medizinische oder psychologische Hilfe sei. „Die Sicherheitsvorkehrungen in ChatGPT sind heute darauf ausgelegt, Notlagen zu erkennen, schädliche Anfragen sicher zu behandeln und Nutzer an reale Hilfsangebote weiterzuleiten. Diese Arbeit ist noch nicht abgeschlossen, und wir verbessern sie weiterhin in enger Abstimmung mit Fachärzten”, erklärte Unternehmenssprecher Drew Pusateri.

Lese-Tipp: Chat-GPT-Entwickler warnen! Diese Jobs werden bald durch KI ersetzt

Die Eltern Leila Turner-Scott und Angus Scott sehen das anders. Sams Mutter erklärt, ihr Sohn habe geglaubt, echte medizinische Beratung zu bekommen, weil die KI wie ein vertrauenswürdiger Mensch geklungen habe. Der Tod ihres Sohnes durch eine versehentliche Überdosis sei vorhersehbar und vermeidbar gewesen, doch OpenAI habe rücksichtslos ein ungetestetes Modell veröffentlicht. „ChatGPT ist darauf ausgelegt, die Nutzer um jeden Preis zu binden. In Sams Fall war dieser Preis sein Leben”, sagt Leila Turner-Scott.

Die Familie fordert drastische Konsequenzen

Die Klage geht weit über Schadensersatz hinaus. Die Familie verlangt unter anderem, dass ChatGPT Gespräche über illegale Drogen künftig automatisch beendet und gefährliche Umgehungsversuche erkennt. Außerdem soll der KI-Gesundheitsdienst „ChatGPT Health“ vorerst gestoppt werden. Selbst GPT-4o soll nach Wunsch der Kläger endgültig vom Markt verschwinden. „Wenn ChatGPT ein Mensch wäre, säße er heute hinter Gittern”, so Samuels Mutter.

Der Fall ist nicht der erste seiner Art. In den USA laufen inzwischen mehrere Verfahren gegen KI-Unternehmen, bei denen Familien den Chatbots gefährliche oder manipulative Antworten vorwerfen.

Verwendete Quellen: Ars Technica